1. Überblick über Power Query und die Ära der Datenautomatisierung in Excel

Durch die Linse eines Anthropologen, der die Evolution des "Bürostammes" beobachtet, sind Daten nicht nur leblose Zahlen; sie sind Informationserbe, der kulturelle Fluss, der Geschäftseinheiten verbindet. Vor Jahrzehnten glich das Zähmen roher, chaotischer Datenströme einer mühsamen Expedition, bei der nur jene "Magier", die die Sprache VBA beherrschten, die Macht zur Steuerung besaßen. Die Einführung von Power Query markierte jedoch eine Ära der Renaissance, in der die Datenverarbeitung durch das elegante ETL-Konzept (Extract – Extrahieren, Transform – Transformieren, Load – Laden) demokratisiert wurde.

"Wenn VBA schwer zu merkende Gebete sind, die die Beharrlichkeit von Gelehrten erfordern, dann ist Power Query eine visuelle Landkarte, auf der jeder Schritt des Reisenden markiert und morgen automatisch wiederholt wird."

Power Query ist nicht nur ein Werkzeug; es ist eine Kunst der Datenanordnung. Anstatt komplexen und zerbrechlichen Programmcode schreiben zu müssen, interagieren moderne Anwender über eine intuitive Benutzeroberfläche mit Daten. Jeder Vorgang – das Löschen einer Spalte, das Filtern von Zeilen oder das Zusammenführen von Tabellen – wird vom System wie ein "Reisetagebuch" (Angewendete Schritte / Applied Steps) aufgezeichnet. Dies ist der Kern des Unterschieds: die Fähigkeit, sich an Prozesse zu erinnern. Wenn im nächsten Monat neue Daten eintreffen, muss der Benutzer das Verarbeitungsritual nicht von vorne beginnen; das System schaut automatisch in das Tagebuch, um das Ergebnis präzise zu reproduzieren.

Der Grund, warum Power Query VBA bei gängigen Datenverarbeitungsaufgaben zunehmend ersetzt, liegt nicht nur in der Geschwindigkeit, sondern auch in der Benutzerfreundlichkeit. Während VBA absolute Präzision in jedem Semikolon erfordert, ermöglicht Power Query das Experimentieren, das Machen von Fehlern und das Zurückdrehen der Zeit mit nur einem Klick. Werfen wir einen Blick auf den epochalen Unterschied zwischen diesen beiden "Zivilisationen" der Datenverarbeitung:

| Merkmal | VBA-Ära (Traditionell) | Power Query-Ära (Modern) |

|---|---|---|

| Ansatz | Code-basiert (Code-based), komplex. | Visuelle Benutzeroberfläche (Visual interface), No-Code. |

| Wartbarkeit | Schwer zu debuggen, wenn der ursprüngliche Autor das Unternehmen verlässt. | Verarbeitungsschritte sind klar sichtbar und für Nachfolger leicht verständlich. |

| Konnektivität | Eingeschränkt, erfordert hohe technische Fachkenntnis für externe Quellen. | Vielfältige Verbindungen: Web, SQL, Ordner, Facebook, PDF... |

| Automatisierung | Befehl muss aktiviert werden (Makro ausführen). | Automatische Aktualisierung (Refresh) gemäß dem gespeicherten Prozess. |

Der Aufstieg von Power Query ist ein Beweis für einen unvermeidlichen Trend: Technologie ist nicht dazu da, das menschliche Denken zu ersetzen, sondern um uns von mühsamen, sich wiederholenden Aufgaben zu befreien. Dadurch gewinnen Fachleute mehr Zeit, um über die wahre Bedeutung hinter den Zahlen nachzudenken – so wie ein Anthropologe innehält, um den Atem der Geschichte zu spüren, anstatt sich nur mit dem Graben auf der Baustelle zu beschäftigen.

- Extrahieren (Extract): Die Fähigkeit, Daten aus den entlegensten Winkeln zu sammeln, von vereinzelten Excel-Dateien bis hin zu massiven Managementsystemen.

- Transformieren (Transform): Bereinigen und Formen von Rohdaten in strukturierte Informationen, wobei überschüssige "Verunreinigungen" aus manuellen Eingabeprozessen entfernt werden.

- Laden (Load): Bringen der wertvollsten Erkenntnisse zurück in die Tabelle oder das Datenmodell, bereit für aussagekräftige Berichte.

2. Datenverbindung aus mehreren Quellen: Flexibel und sicher

Früher habe ich oft scherzhaft zu Kollegen gesagt, dass das Erstellen von Berichten wie der Einkauf für ein Festessen zu Silvester ist. Jede Zutat kommt von woanders: Kräuter an diesem Stand, Fleisch und Fisch an jenem. In der Datenwelt sind unsere „Marktstände“ vereinzelte Excel-Dateien, aus Software exportierte CSV-Files oder sogar Daten, die auf den Websites der Konkurrenz „hängen“. Jedes Datenstück manuell zusammenzusuchen und in eine Gesamtdatei einzufügen, ist nicht nur mühsam, sondern auch extrem fehleranfällig.

Die Funktion „Daten abrufen“ (Get Data) erscheint wie ein smarter Supermarkt-Einkaufswagen, der dir hilft, alles mit nur wenigen Klicks an einem Ort zusammenzuführen. Anstatt jede Datei einzeln öffnen zu müssen, weist du dem Tool einfach den Weg zur Quelle: von vertrauten Excel- und CSV-Dateien bis hin zu einem ganzen Ordner mit Dutzenden von Monatsberichten oder, noch fortschrittlicher, der direkten Verbindung zu SQL-Datenbanken des Unternehmens und Online-Websites.

Was mich an „Get Data“ am meisten begeistert, ist nicht die Geschwindigkeit, sondern die Philosophie der „Read-only connection“ (schreibgeschützte Verbindung). Stell es dir so vor, als würdest du von draußen durch das Fenster eines Juweliergeschäfts schauen. Du kannst jedes Detail beobachten, Notizen machen, sogar Kopien davon zeichnen, aber du kannst das Originalstück in der Vitrine absolut nicht verrücken oder beschädigen.

"Originaldaten sind ein Vermögenswert, und Get Data ist der Wächter dieses Vermögens. Sie können die Daten in der Arbeitsoberfläche formen und anpassen, aber die Quelldatei bleibt immer unberührt und sicher."

Hier ist die Funktionsweise dieses „Einkaufswagens“ für die verschiedenen gängigen Datenquellen, die ich regelmäßig nutze:

| Datenquelle | Wie „Get Data“ darauf zugreift | Praktische Vorteile |

|---|---|---|

| Excel / CSV | Direkte Verbindung zum Dateipfad. | Keine Sorge mehr über falsches Kopieren und Einfügen von Zeilen oder Spalten. |

| Ordner (Folder) | Zusammenführen aller Dateien mit derselben Struktur in einem Ordner. | Einfach die neue Datei in den Ordner ziehen, und die Daten werden automatisch dem Bericht hinzugefügt. |

| Website | Scannen der auf der URL angezeigten Tabellen. | Aktualisierung von Wechselkursen oder Aktienpreisen aus dem Web im Handumdrehen. |

| SQL-Datenbank | Zugriff auf den Datenbankserver des Unternehmens. | Verarbeitung von Millionen von Datenzeilen, ohne den eigenen Rechner zum Abstürzen zu bringen. |

Diese Flexibilität befreit uns von der Rolle des „Handwerkers“ und macht uns zum „Datenarchitekten“. Du musst dir keine Sorgen machen, dass jemand versehentlich eine Zeile in der Quelldatei löscht, während du am Bericht arbeitest. Alle Änderungen, die du während der Verarbeitung vornimmst (wie das Umbenennen von Spalten oder zusätzliche Berechnungen), finden nur auf der „Oberfläche“ statt, wodurch die Daten sauberer und professioneller werden, ohne den Originalwert zu verfälschen. Das ist genau die Sicherheit und Transparenz, die sich jeder wünscht, der mit Zahlen arbeitet.

3. Fortgeschrittene Datentransformations- und Standardisierungstechniken

Wenn man Rohdaten als archäologische Überreste betrachtet, die unter dem Staub der Zeit begraben sind, dann ist die Datentransformation (Data Transformation) der raffinierte Rekonstruktionsprozess eines Anthropologen. Diese Arbeit ist nicht bloß ein Umordnen von Zahlen, sondern eine Reise des Entschlackens, um zum ursprünglichsten und reinsten Wesen der Information zurückzufinden. In der Welt von Power Query oder modernen Verarbeitungswerkzeugen ist die Datenstandardisierung ein obligatorisches Ritual, um Chaos in ein geordnetes System zu verwandeln.

"Saubere Daten sind nicht nur präzise Zahlen; sie sind eine wahrheitsgetreue Interpretation der Realität, in der jede Zeile und Spalte einen eigenen historischen Wert in sich trägt."

Der Bereinigungsvorgang beginnt mit dem Entfernen bedeutungsloser „Stille“: leerer Zeilen (Remove Blank Rows). In einer Datentabelle sind leere Zeilen wie Brüche in einer Chronik, die wieder verbunden werden müssen, um die Kontinuität zu gewährleisten. Als Nächstes ermöglicht uns die Technik „Spalte teilen“ (Split Column), komplexe Informationscluster in einzelne Komponenten zu zerlegen – ähnlich wie man Artefakte nach Material und Alter sortiert. Die Änderung des Datentyps (Data Type) ist wiederum ein wichtiger Identifizierungsschritt, der den rechtlichen Status der Daten festlegt: was Text ist, was Zahlen sind und was ewige Zeitstempel sind.

| Operation | Technisches Wesen | Praktischer Wert |

|---|---|---|

| Split Column | Zerlegen von Zeichenfolgen basierend auf Trennzeichen oder Positionen. | Erhöhung des Detailgrads für die Attributanalyse. |

| Change Type | Festlegen des Speicherformats (Date, Decimal, Percentage...). | Gewährleistung präziser Berechnungen und Speicheroptimierung. |

| Unpivot Columns | Umwandlung von Spaltenüberschriften in Zeilenwerte. | Umstrukturierung von horizontalen in vertikale Daten für Berichtszwecke. |

Insbesondere die Unpivot-Funktion wird als „räumliche Revolution“ in der Datenverarbeitung bezeichnet. Anstatt Informationen horizontal auszubreiten (Matrix-Stil), dreht Unpivot die gesamte Struktur, um sie in eine Listenform (Tabular-Stil) zu bringen. Dies ist die ultimative Technik, die Benutzern hilft, Daten aus den Fesseln statischer Tabellenkalkulationen zu befreien, sodass wir die Variation von Metriken über verschiedene Raum- und Zeitdimensionen hinweg höchst flexibel beobachten können.

Jeder Schritt auf dieser Reise wird streng unter dem Punkt „Applied Steps“ festgehalten. Dies ist nicht nur eine Liste von Vorgängen, sondern ein Reisetagebuch, das jede vom Bearbeiter vorgenommene Änderung dokumentiert. Dieser Mechanismus ermöglicht es uns, in der Zeit zurückzugehen (Undo/Modify) und die Transformation der Daten zu jedem Zeitpunkt in der Vergangenheit zu beobachten. Diese absolute Kontrolle hilft, die Integrität der Originaldaten zu bewahren und gleichzeitig einen transparenten, vererbbaren und wiederholbaren Prozess zu schaffen – ein Sinnbild für Exzellenz im Zeitalter moderner Büro-Technologie.

4. Zusammenführen und Verknüpfen von Daten mit Merge und Append

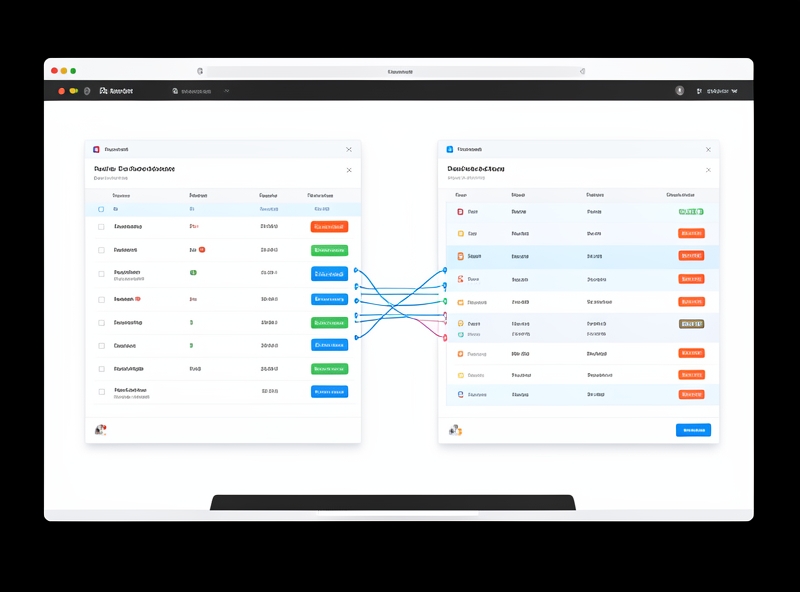

In der realen Datenverarbeitung ist der Besitz separater Dateien das größte Hindernis für die Effizienz. Append und Merge sind zwei Kernmechanismen, um dieses Hindernis zu überwinden und riskante manuelle Vorgänge vollständig zu ersetzen.

Anfügen (Append): Wird verwendet, um Tabellen mit ähnlicher Struktur übereinander zu stapeln. Anstatt Daten aus 12 monatlichen Umsatzdateien manuell in eine zusammenfassende Datei zu kopieren, automatisiert Append das Sammeln aller Daten aus einem Ordner. Voraussetzung: Die Spaltenüberschriften müssen exakt übereinstimmen, um redundante Spalten zu vermeiden.

Zusammenführen (Merge): Dies ist eine fortschrittliche Alternative zu SVERWEIS (VLOOKUP) oder XVERWEIS (XLOOKUP). Merge ermöglicht die Verknüpfung zweier Tabellen basierend auf gemeinsamen Spalten (Key columns). Der Unterschied liegt in der Fähigkeit, verschiedene Join-Typen zu verarbeiten und die Datenintegrität beizubehalten, selbst wenn der Umfang der Tabellenkalkulation Millionen von Zeilen erreicht.

"Die Verwendung von SVERWEIS bei 100.000 Zeilen bringt Excel zum Absturz; die Verwendung von Merge in Power Query dauert weniger als 3 Sekunden, um das Ergebnis zu liefern. Das ist keine Vorliebe, das ist ein technischer Standard."

| Kriterium | SVERWEIS / XVERWEIS | Power Query Merge |

|---|---|---|

| Verarbeitungsgeschwindigkeit | Nimmt mit der Anzahl der Formeln ab | Schnell, Verarbeitung im Cache |

| Wartbarkeit | Fehleranfällig beim Einfügen/Löschen von Spalten | Fixiert nach Spaltennamen, extrem stabil |

| Verknüpfungstyp | Nur Abgleich von links nach rechts (SVERWEIS) | Left, Right, Inner, Full Outer, Anti Join |

| Dateigröße | Nimmt stark zu durch zehntausende Formeln | Optimiert, speichert nur den Verarbeitungsprozess |

Für eine effektive Implementierung erfordert der technische Prozess die Einhaltung von 3 Schritten:

- Standardisierung: Formatieren der Eingabedaten als Tabelle (Strg + T), um die Dynamik bei wachsenden Daten zu gewährleisten.

- Auswahl des Join-Typs: Verwenden Sie „Left Outer Join“, um alle Daten der Haupttabelle zu behalten, oder „Inner Join“, wenn nur Datensätze übernommen werden sollen, die in beiden Tabellen vorhanden sind.

- Erweitern (Expand): Wählen Sie nach dem Merge nur die tatsächlich benötigten Spalten aus, um die Systemressourcen zu optimieren.

Praxistests zeigen, dass die Umstellung von Suchfunktionen auf Merge die Dateigröße um 60 % reduziert und die in der herkömmlichen Büroarbeit üblichen #BEZ!-Fehler vollständig eliminiert.

5. Automatisierung von Berichtsprozessen mit der Refresh-Funktion

Waren Sie schon einmal in der Situation, dass Sie gerade einen endlos langen Bericht fertiggestellt haben, der Schweiß noch nicht einmal getrocknet ist, und Ihr Chef sagt: "Schick mir bitte eine andere Datei, die Daten haben sich gerade geändert"? In diesem Moment fühlt es sich so an, als hätte gerade jemand mit schlammigen Schuhen das frisch geputzte Haus betreten. Mir ging es genauso wie Ihnen: Ich mühte mich damit ab, jede einzelne Datenzeile aus der Software zu löschen und neu in Excel zu kopieren, nur um dann mühsam jedes Diagramm anzupassen. Doch alles änderte sich, als ich lernte, Excel beizubringen, die Arbeit mithilfe der Refresh-Funktion für mich zu erledigen.

Um diese Reise zur Arbeitserleichterung zu beginnen, müssen Sie als Erstes die verarbeiteten Daten (normalerweise über Power Query) an den richtigen Ort exportieren. Je nach Verwendungszweck können Sie "Laden in" eine Excel-Tabelle (normale Tabelle) wählen, wenn Sie jede einzelne Zeile zur Abstimmung sehen möchten, oder sie direkt in das Datenmodell laden, wenn Ihre Daten Millionen von Zeilen umfassen und nur für Pivot-Tabellen oder Power BI benötigt werden. Stellen Sie sich eine Excel-Tabelle wie einen fertig angerichteten Teller vor, während das Datenmodell das riesige Zutatenlager hinter der Küche ist; je nachdem, was der Gast wünscht, wählen Sie die passende Art des Servierens.

Das wahre Wunder liegt in der Schaltfläche Alle aktualisieren. Wenn Sie die Verbindungen zu den Quellen (wie CSV-Dateien, SQL oder Ordnern mit monatlichen Verkaufsdateien) einmal eingerichtet haben, müssen Sie bei jedem neuen Dateneingang nicht wieder von vorne anfangen. Ein einfacher Klick auf die Registerkarte Daten -> Alle aktualisieren genügt, und der gesamte Prozess – von der Datenfilterung über die Prozentberechnung bis hin zur Aktualisierung der Farben im Diagramm – läuft automatisch ab wie eine voreingestellte Domino-Kette.

"Der Höhepunkt der Bürotechnologie besteht nicht darin, schneller zu arbeiten, sondern sicherzustellen, dass man alte Aufgaben nie wieder wiederholen muss."

Damit Ihre Berichte "intelligenter" werden, stelle ich oft ein paar kleine, aber äußerst nützliche Optionen in den Verbindungseigenschaften ein. Sie können sich an der untenstehenden Vergleichstabelle orientieren, um die für Ihre Gewohnheiten passende "Aktualisierungsmethode" zu wählen:

| Aktualisierungsmodus | Funktionsweise | Wann geeignet? |

|---|---|---|

| Manuell | Sie klicken bei Bedarf auf die Schaltfläche "Alle aktualisieren". | Quelldaten ändern sich selten oder Sie möchten den Zeitpunkt der Aktualisierung kontrollieren. |

| Beim Öffnen aktualisieren | Der Bericht wird automatisch aktualisiert, sobald Sie die Excel-Datei öffnen. | Stellt sicher, dass die Informationen zu Beginn des Arbeitstages immer auf dem neuesten Stand sind. |

| Alle X Minuten aktualisieren | Automatische Aktualisierung nach einem festgelegten Zeitintervall (z. B. alle 5 Minuten). | Für Berichte zur Echtzeitüberwachung (Real-time monitoring). |

Glauben Sie mir, das Gefühl, an einer Tasse Kaffee zu nippen und zuzusehen, wie die Zahlen automatisch tanzen und die Diagramme nach nur einem "Klick" ihre Form ändern, ist ein Privileg, das jeder Büroangestellte genießen sollte. Es hilft Ihnen nicht nur, Fehler durch manuelle Eingriffe zu reduzieren, sondern gibt Ihnen vor allem die Zeit, wirklich über die Bedeutung dieser Zahlen nachzudenken, anstatt nur eine "Dateneingabemaschine" zu sein.

6. Fazit

Die Integration von Power Query in den Workflow ist nicht nur ein einfaches Software-Upgrade, sondern eine umfassende "Revolutionierung" des gesamten Denkens in der Datenverarbeitung. Für echte "Geeks" verstehen wir, dass der Kernwert in der M Language-Engine liegt – einer extrem leistungsstarken funktionalen Programmiersprache, die hinter jedem Mausklick steht. Die Fähigkeit zum Query Folding (Verschieben von Verarbeitungsschritten zur Datenquelle wie SQL Server) minimiert den Systemressourcenverbrauch und verwandelt chaotische, "verrauschte" Datendateien in präzise Standard-Schema-Tabellen mit absoluter Genauigkeit, wobei menschliche Fehler vollständig eliminiert werden.

Um jedoch im Bereich der Datenkunst wirklich das "Master"-Niveau zu erreichen, ist Power Query nur der Anfang – die ETL-Phase (Extract - Transform - Load). Ich empfehle Ihnen, eine starke "Allianz" zwischen Power Query und Power Pivot aufzubauen. Während Power Query die Rolle der Bereinigung und Formgebung übernimmt, geschieht in Power Pivot die eigentliche "Magie" mit der VertiPaq-Engine – einer extrem schnellen In-Memory-Datenkompression.

"Hören Sie nicht bei der Datenbereinigung auf. Verwandeln Sie sie durch die Kraft der Datenmodellierung in prognosefähige Informationen."

- Leistungsoptimierung: Power Pivot ermöglicht die Verarbeitung von zig Millionen Datenzeilen, ohne das System "einzufrieren", wie es bei herkömmlichen VLOOKUP- oder SUMIFS-Funktionen der Fall ist.

- Die Macht von DAX (Data Analysis Expressions): Durch die Kombination mit Power Pivot können Sie komplexe DAX-Funktionen nutzen, um Kennzahlen (Measures) in Echtzeit (Time Intelligence) zu berechnen, was mit Standard-Excel nur schwer reibungslos umsetzbar ist.

- Konsistenz: Wenn Sie beide kombinieren, schaffen Sie eine "Single Source of Truth" (einzige Quelle der Wahrheit), die sicherstellt, dass alle Berichte der verschiedenen Abteilungen in Bezug auf Logik und Ergebnisse stets synchron sind.

Die Synergie zwischen dem Standardisierungsprozess von Power Query und den mehrdimensionalen Analysefähigkeiten von Power Pivot ist der Schlüssel zur Erschließung des verborgenen Wissensschatzes in Big Data. Wenn Sie möchten, dass Ihr System nicht nur schnell läuft, sondern auch "intelligent" ist, beginnen Sie noch heute mit der Verfeinerung Ihrer Data Models. Das ist nicht nur Bürotechnologie, das ist die Kunst der Präzision!